近年来,互联网上由人工智能生成内容引发的虚假信息问题日益严峻。尽管已有多种检测 AI 生成内容的方法问世,但始终未能实现高准确率。甚至 OpenAI 也因其 AI 分类器在检测 AI 文本方面表现不佳而暂停了该服务。

“我们将继续努力优化检测技术,以便用户能够辨别音频或视频内容是否由 AI 生成。”——OpenAI

为应对这一挑战,谷歌决定开源其检测 AI 生成内容的工具 SynthID,以助力打击虚假信息。

什么是 SynthID?

SynthID 是谷歌 DeepMind 开发的一项技术,可通过将数字水印嵌入到 AI 生成的文本、图像、音频或视频中,识别和标记 AI 生成内容。

水印会影响生成内容的质量或速度吗?

据谷歌称,SynthID 不会影响生成内容的质量、准确性、创意或速度。这一技术现已通过谷歌的 负责任生成式 AI 工具包开源,并在 Hugging Face 上提供,供开发者将其集成到 AI 应用中。

SynthID 的工作原理

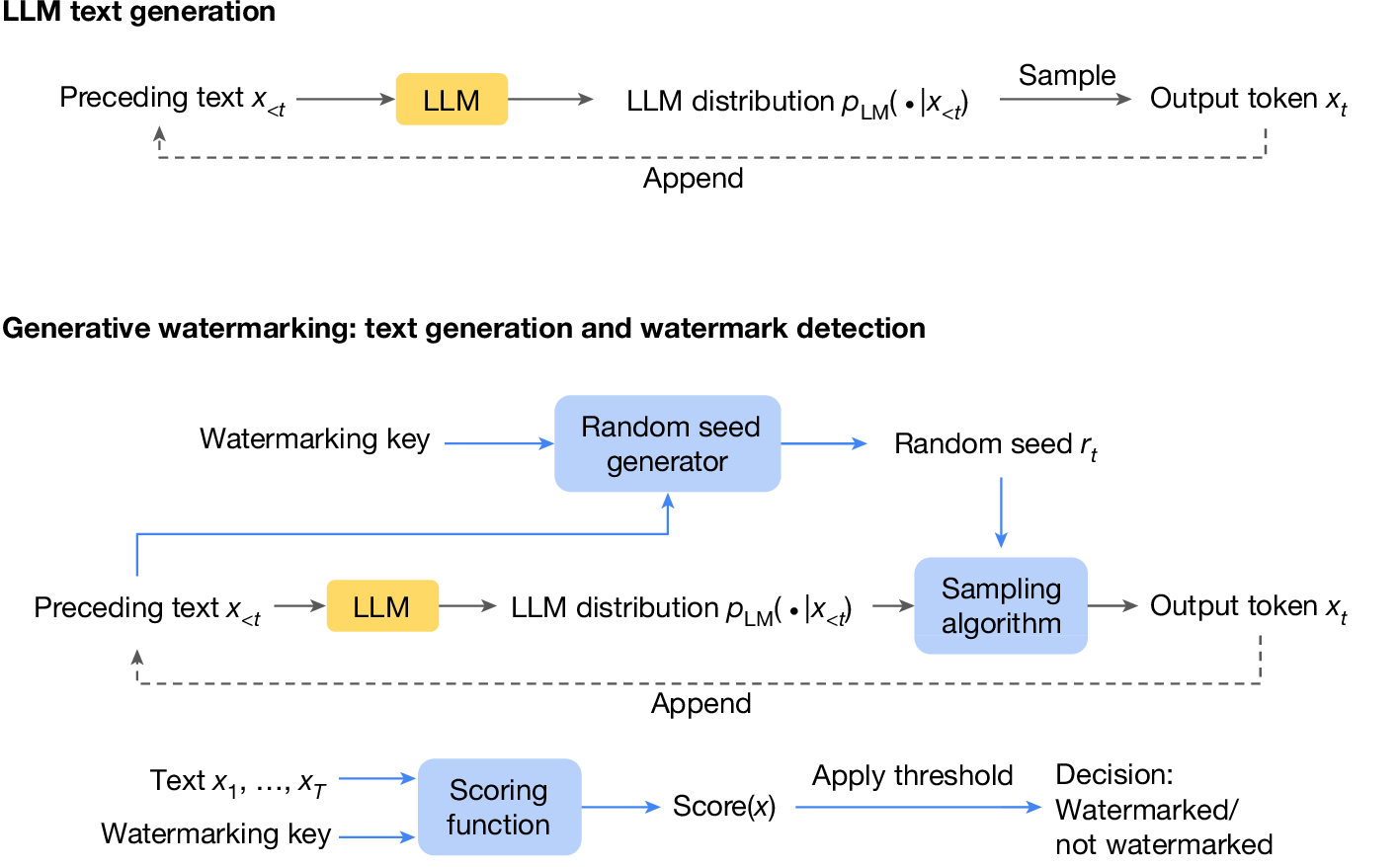

SynthID 的水印技术通过在生成过程中嵌入标记,实现内容质量与可检测性的平衡。生成和检测的基本工作流程如下:

-

基础文本生成:标准大语言模型根据上下文生成内容。

-

水印集成:水印系统在生成的文本中嵌入标记,使用 Tournament 采样算法实现水印嵌入。

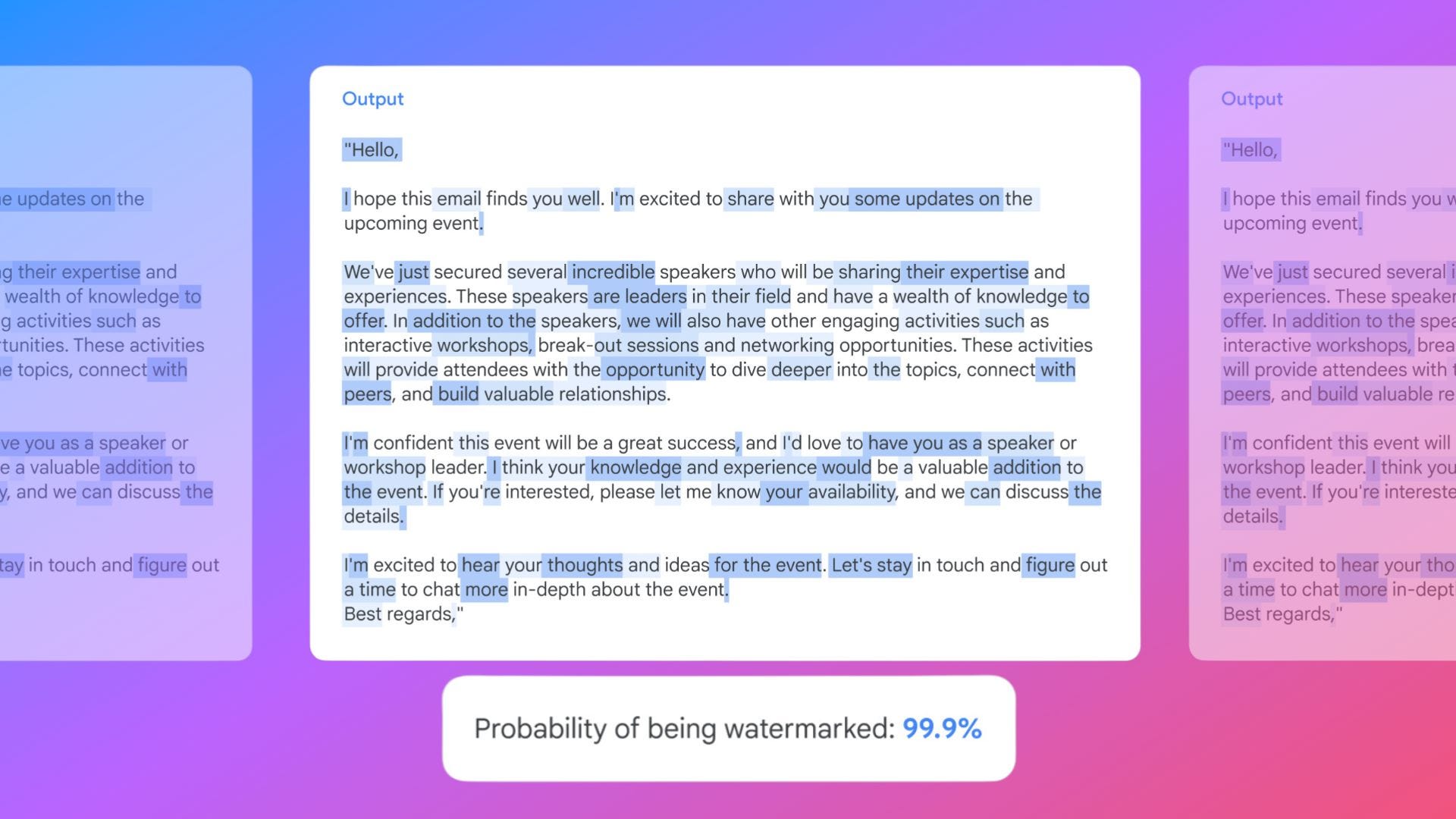

例如,当要求 AI 使电子邮件更专业时,带水印的修订版本将被添加至文本中。

应用和检测水印

通过 SynthIDTextWatermarkingConfig 设置,可以在文本生成时应用水印,并通过训练好的检测器识别水印:

from transformers import (

AutoModelForCausalLM,

AutoTokenizer,

SynthIDTextWatermarkingConfig,

)

# 初始化模型和分词器

tokenizer = AutoTokenizer.from_pretrained('repo/id')

model = AutoModelForCausalLM.from_pretrained('repo/id')

# 配置 SynthID Text 水印

watermarking_config = SynthIDTextWatermarkingConfig(

ngram_len=5,

keys=[654, 400, 836, 123, 340, 443, 597, 160, 57, 29, 590, 639, 13, 715, 468, 990, 966, 226, 324, 585, 118, 504, 421, 521, 129, 669, 732, 225, 90, 960],

sampling_table_size=65536,

sampling_table_seed=0,

context_history_size=1024

)

# 生成带水印文本

tokenized_prompts = tokenizer(["在这里输入您的提示"])

output_sequences = model.generate(

**tokenized_prompts,

watermarking_config=watermarking_config,

do_sample=True,

)

watermarked_text = tokenizer.batch_decode(output_sequences)

如何尝试 SynthID

您可以通过以下方式体验 SynthID:

- 在 Google Colab Notebook 中在线试用 SynthID。

- 在 Hugging Face 上访问 SynthID。

- 在本地使用 SynthID(建议在虚拟环境中运行)。

目前,Hugging Face 上的 SynthID 可能暂时无法使用。可以尝试 Google Colab,它提供了 SynthID 的端到端使用示例。

现有的限制

尽管 SynthID 在检测方面取得了进展,但它仍然存在一些限制:

- 模型依赖:SynthID 仅适用于谷歌的 Gemini 模型。

- 编辑敏感:对带水印文本进行大幅修改可能会降低检测准确性。

- 翻译问题:翻译或大量改写内容后,水印可能失效。

未来展望

谷歌此次通过 SynthID 的推出展示了其在控制 AI 生成内容扩散中的努力。尽管目前 SynthID 仅适用于谷歌的 Gemini 模型,但希望未来其他公司如 OpenAI、Anthropic 等也能开发出相应的检测工具,从而进一步减少 AI 生成内容带来的误导信息。